En une seule journée, la startup basée à Paris a fait trois grandes annonces qui confirment son objectif de devenir une pierre angulaire incontournable de l'infrastructure mondiale de l'IA. Voici les effets concrets de cette situation.

À retenir :

- Mistral Small 4 combine pour la première fois raisonnement, multimodalité et outil de code en un seul modèle, sous licence Apache 2.0.

- Mistral rejoint en tant que membre fondateur de la coalition Nemotron de NVIDIA aux côtés de Perplexity, Cursor et Black Forest Labs.

- Leanstral est le premier agent open source capable de produire des preuves formelles pour Lean 4, et son rapport coût/performance revendiqué est 15 fois supérieur à celui des concurrents généraux.

- Ces trois annonces montrent que Mistral se repositionne désormais non pas comme une alternative nationale, mais comme un acteur de référence mondial.

Small 4 : Un modèle qui change la donne

Jusqu'à présent, les équipes techniques souhaitant utiliser les modèles Mistral devaient choisir entre Magistral pour le raisonnement, Pixtral pour le traitement d'images, et Devstral pour l'outil de code. Mistral Small 4 met fin à cette fragmentation.

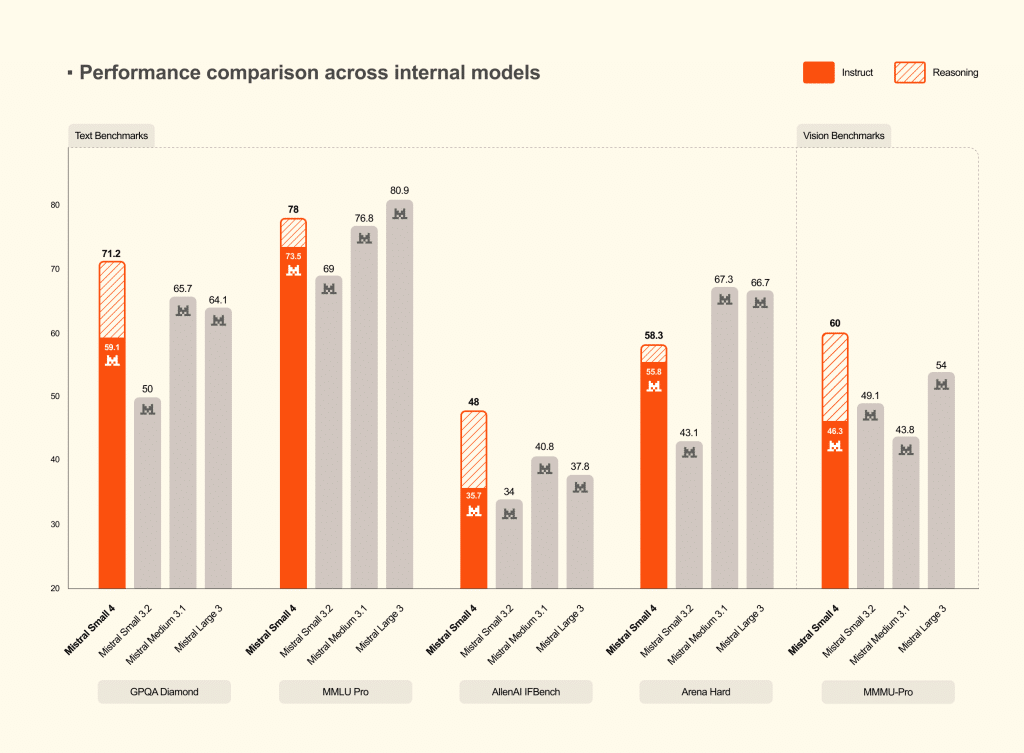

Le modèle repose sur une architecture de Mélange d'Experts (MoE) avec un total de 119 milliards de paramètres, mais seulement 6 milliards sont actifs à chaque requête. Ce mode de fonctionnement permet de limiter le coût de calcul à chaque inférence tout en préservant la capacité globale. Mistral offre, par rapport à Small 3, un délai réduit de 40 % et trois fois plus de requêtes par seconde dans une configuration optimisée.

La fenêtre de contexte atteint 256 000 tokens, permettant de traiter de longs documents sans les couper. Le modèle accepte à la fois du texte et des images en entrée.

La fonctionnalité la plus remarquable pour les usages professionnels est le paramètre reasoning_effort. Il permet à l'utilisateur de choisir entre une réponse rapide et légère équivalente au comportement de Small 3 et une analyse plus approfondie, étape par étape. Ainsi, une seule distribution répond aux besoins qui nécessitaient auparavant trois.

Dans les benchmarks, Mistral rapporte que lorsque le raisonnement est activé, Small 4 égalise ou dépasse le GPT-OSS 120B tout en produisant des sorties significativement plus courtes. Des sorties plus courtes signifient moins de délai, des coûts d'inférence réduits et une meilleure expérience utilisateur en production.

Le modèle est disponible en tant qu'API Mistral, sur Hugging Face et comme conteneur NVIDIA NIM optimisé pour les déploiements sur site. Publié sous licence Apache 2.0, il est compatible avec les cadres d'inférence courants : vLLM, llama.cpp, SGLang et Transformers.

Coalition Nemotron : Mistral à la table des grands

C'est probablement l'annonce la plus stratégique de la journée. Mistral rejoint en tant que membre fondateur de la coalition Nemotron de NVIDIA, aux côtés de Cursor, Perplexity, Black Forest Labs et du laboratoire Mira Murati.

Le but de cette coalition est de co-développer un modèle de base open source, Nemotron 4, qui sera entraîné sur le cloud DGX de NVIDIA. Le modèle sera ensuite publié en open source pour la personnalisation de toute l'industrie. Chaque membre apporte une expertise complémentaire, comme l'architecture multilingue et de modèle pour Mistral, la recherche pour Perplexity, l'orchestration pour LangChain, et la multimodalité pour Black Forest Labs.

Pour Mistral, cela signifie un accès à l'infrastructure de calcul de NVIDIA, permettant d'entraîner des modèles à une échelle qu'il ne pourrait pas financer seul. En retour, la startup offre des techniques d'entraînement, des capacités multimodales et des outils de réglage fin orientés vers l'entreprise.

La logique industrielle est claire. Face aux écosystèmes fermés d'OpenAI et de Google, cette coalition se structure comme une force coordonnée du camp open source. Pour NVIDIA, un modèle de référence optimisé pour ses puces augmente mécaniquement la demande en matériel.

Cette alliance n'est pas sans tensions. Le cloud DGX dans lequel Nemotron 4 sera formé appartient à NVIDIA. Mistral a bien compris cela : l'entreprise investit dans ses propres capacités de calcul en France et en Suède, de sorte que ce partenariat reste un choix stratégique et ne devient pas une dépendance obligatoire. La question de la souveraineté technologique est toujours d'actualité : Mistral renforce son lien avec un acteur soumis à la réglementation américaine à l'étranger.

Leanstral : La preuve que l'IA est correcte

Le troisième annonce est le plus technique. Aujourd'hui, il s'adresse à un public limité, mais il aborde une question fondamentale concernant l'agence.

Le problème que Leanstral essaie de résoudre

Lorsque aujourd'hui une agence IA génère du code, le résultat est probabiliste. Le code semble correct, passe les tests, mais il n'y a aucune garantie certaine. La vérification repose sur les humains ; ils relisent, testent et corrigent. À mesure que les agences produisent plus rapidement, ce goulot d'étranglement humain devient critique.

Il existe une solution à ce problème : la preuve formelle. Un assistant de preuve comme Lean 4 permet à un développeur d'écrire non seulement un programme, mais aussi sa preuve mathématique. Si la preuve est valide, cela garantit que le code est correct ; "probablement correct" non, "correct dans les cas testés" non, mais correct au sens mathématique. Lean 4 est utilisé par des mathématiciens pour formuler des preuves complexes et par des ingénieurs pour certifier des logiciels critiques.

Le problème est que rédiger des preuves dans Lean 4 est une tâche spécialisée, lente et laborieuse. C'est là que Leanstral essaie de combler le vide.

Ce que Leanstral fait concrètement

Leanstral, une agence IA avec 6 milliards de paramètres actifs, a été spécifiquement formée pour produire des preuves formelles. Elle ne se contente pas de générer du code : elle produit également la preuve qui certifie ce code. Lean 4 valide ensuite cette preuve. Si elle est invalide, elle est rejetée. Le vérificateur ne peut pas être corrompu.

C'est la première agence de ce type en open source pour Lean 4. Les systèmes existants créent soit des couches autour de modèles généraux, soit sont limités à des problèmes mathématiques isolés. Leanstral est conçu pour travailler dans de véritables pools formels, avec une architecture rare et une optimisation spécifique aux tâches de preuve.

Benchmarks et limitations

Dans FLTEval, sur ses propres ensembles d'évaluation, Leanstral obtient 26,3 points pour 36 dollars (pass@2), tandis que Claude Sonnet 4.6 obtient 23,7 points pour 549 dollars. À pass@16, Leanstral obtient 31,9 points et devance Sonnet de 8 points. Claude Opus 4.6 est en tête en termes de qualité absolue avec 39,6 points, mais coûte 1 650 dollars, soit 92 fois plus cher.

Ces chiffres nécessitent une lecture attentive. FLTEval est un benchmark interne non reproductible par des tiers. La comparaison des coûts entre un modèle privé avec 6 milliards de paramètres actifs et de grands modèles généraux n'est pas impartiale : c'est une comparaison entre un outil optimisé pour une tâche spécifique et un couteau suisse. La capacité de Leanstral à dépasser le projet mathématique FLT dans lequel il a été évalué n'a pas encore été prouvée. Enfin, tous les tests ont été réalisés dans l'environnement Mistral Vibe.

Pourquoi cela est important au-delà des mathématiques

Le véritable enjeu est la confiance dans les agences autonomes. Aujourd'hui, une agence IA écrit du code et traite des données sans vérification de chaque ligne. Une agence capable de prouver formellement ce que le code est censé faire change la donne : l'humain spécifie le résultat attendu, la machine prouve qu'il a été produit. L'audit passe de la vérification ligne par ligne à la définition des spécifications.

Leanstral est immédiatement disponible via Mistral Vibe (commande /leanstall), accessible par une API gratuite (labs-leanstral-2603) et en téléchargeant directement les poids sous la licence Apache 2.0.

Un repositionnement stratégique définitif

Lorsque ces trois annonces sont lues ensemble, elles ne sont pas que des lancements de produits isolés. Elles définissent une feuille de route.

- Small 4 couvre le marché des entreprises avec un modèle polyvalent, performant et économique.

- La coalition Nemotron apporte à Mistral une valeur dans la définition des normes mondiales de l'IA open source.

- Leanstral montre une profondeur de R&D au-delà des modèles de conversation.

Mistral vise un chiffre d'affaires d'un milliard d'euros cette année, construit un centre de données en Suède, a signé un contrat avec le ministère de la Défense en janvier et a acquis Koyeb en février. Tout cela est réalisé en maintenant une politique open source cohérente avec la licence Apache 2.0. La question qui reste ouverte est celle de la durabilité : combien de temps une entreprise en hypercroissance peut-elle continuer à publier ses modèles gratuitement tout en finançant l'énorme infrastructure nécessaire pour les entraîner ?

Commentaires

(3 Commentaires)