Em um único dia, a startup com sede em Paris fez três grandes anúncios que confirmam seu objetivo de se tornar uma pedra angular indispensável na infraestrutura global de IA. Aqui estão os efeitos concretos dessa situação.

O que lembrar:

- Mistral Small 4 combina, pela primeira vez, raciocínio, multimodalidade e ferramenta de código em um único modelo, sob a licença Apache 2.0.

- Mistral se junta como membro fundador da coalizão Nemotron da NVIDIA, junto com Perplexity, Cursor e Black Forest Labs.

- Leanstral é a primeira agência de código aberto capaz de gerar provas formais para Lean 4, e a alegada relação custo/desempenho é 15 vezes superior a concorrentes gerais.

- Esses três anúncios mostram que a Mistral se reposicionou não mais como uma alternativa nacional, mas como um jogador de referência global.

Small 4: Um modelo que muda a distribuição

Até agora, as equipes técnicas que desejavam usar os modelos Mistral tinham que escolher entre Magistral para raciocínio, Pixtral para processamento de imagens e Devstral para ferramentas de código. Mistral Small 4 encerra essa fragmentação.

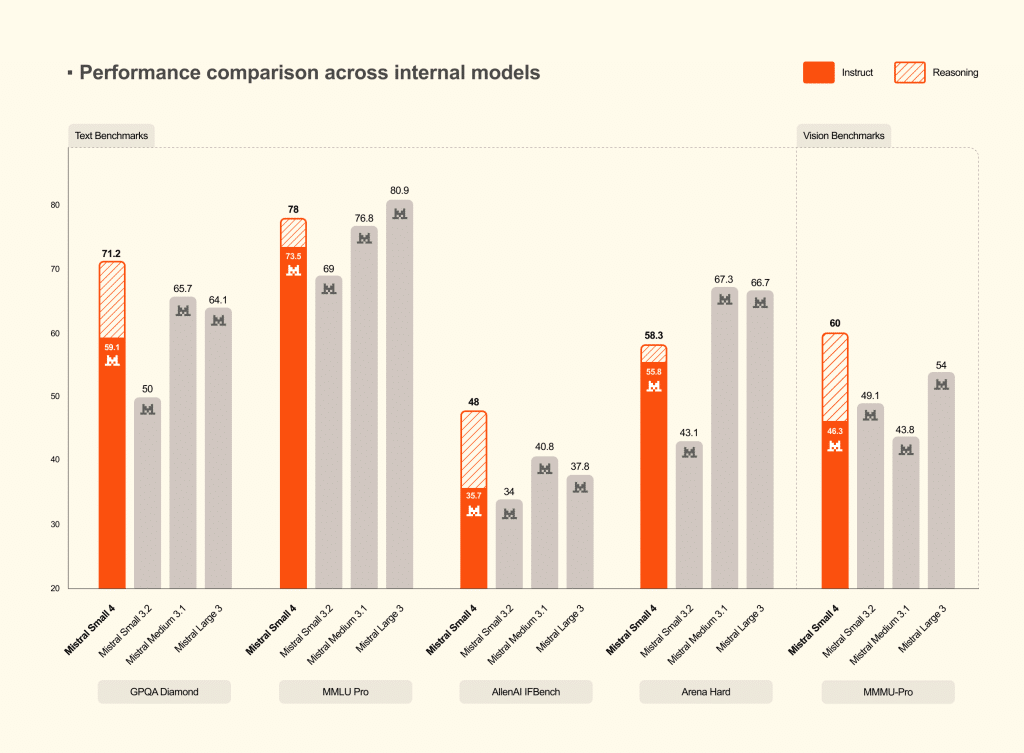

O modelo é baseado em uma arquitetura de Mistura de Especialistas (MoE) com um total de 119 bilhões de parâmetros, mas apenas 6 bilhões estão ativos em cada consulta. Essa forma de operação permite limitar o custo computacional em cada inferência, enquanto mantém a capacidade geral. Em comparação com o Small 3, a Mistral oferece 40% menos latência e três vezes mais consultas por segundo em uma configuração otimizada.

A janela de contexto alcançando 256.000 tokens oferece a possibilidade de processar documentos longos sem cortes. O modelo aceita tanto texto quanto imagens como entrada.

A adição mais notável para usos profissionais é o parâmetro reasoning_effort. Ele permite que o usuário escolha entre uma resposta rápida e leve equivalente ao comportamento do Small 3 ou uma análise mais profunda e passo a passo. Portanto, uma única distribuição atende a necessidades que anteriormente exigiam três.

Nos benchmarks, a Mistral relata que quando o raciocínio é ativado, o Small 4 iguala ou supera o GPT-OSS 120B e produz saídas significativamente mais curtas. Saídas mais curtas significam menos latência, custos de inferência mais baixos e uma melhor experiência do usuário em produção.

O modelo está disponível como API Mistral, Hugging Face e contêiner NVIDIA NIM otimizado para implantações locais. Publicado sob a licença Apache 2.0, é compatível com estruturas de inferência amplamente utilizadas: vLLM, llama.cpp, SGLang e Transformers.

Coalizão Nemotron: Mistral à mesa dos grandes

Este é provavelmente o anúncio mais estratégico do dia. Mistral se junta como membro fundador da coalizão Nemotron da NVIDIA, junto com Cursor, Perplexity, Black Forest Labs e o laboratório de Mira Murati.

O objetivo dessa coalizão é co-desenvolver um modelo base de código aberto, o Nemotron 4, que será treinado na nuvem DGX da NVIDIA. O modelo será então publicado como código aberto para personalização por toda a indústria. Cada membro traz uma especialização complementar, como arquitetura de modelo multilíngue para Mistral, pesquisa para Perplexity, orquestração para LangChain e multimodalidade para Black Forest Labs.

Para a Mistral, isso significa acesso à infraestrutura de computação da NVIDIA, permitindo treinar modelos em escalas que não poderia financiar sozinha. Em troca, a startup oferece técnicas de treinamento, capacidades multimodais e ferramentas de ajuste fino voltadas para o negócio.

A lógica industrial é clara. Contra os ecossistemas fechados da OpenAI e do Google, essa coalizão se estrutura como uma força coordenada do campo de código aberto. Para a NVIDIA, um modelo de referência otimizado para seus chips aumenta mecanicamente a demanda por hardware.

Esta aliança não é sem tensões. A nuvem DGX onde o Nemotron 4 será treinado pertence à NVIDIA. A Mistral entendeu isso bem: a empresa está investindo em suas próprias capacidades de computação na França e na Suécia, de modo que essa parceria permanece uma escolha estratégica e não se torna uma dependência obrigatória. A questão da soberania tecnológica ainda está em pauta: a Mistral está fortalecendo seu vínculo com um ator sujeito a regulamentações estrangeiras dos EUA.

Leanstral: A prova de que a IA está correta

A terceira anúncio é a mais técnica. Hoje, ela se dirige a um público limitado, mas aborda uma questão fundamental sobre o problema da agência.

O problema que Leanstral tenta resolver

Hoje, quando uma agência de IA gera código, o resultado é probabilístico. O código parece correto, passa nos testes, mas não há garantia definitiva. A validação depende das pessoas; elas leem novamente, testam e corrigem. À medida que as agências produzem mais rapidamente, esse estrangulamento humano se torna crítico.

Há uma solução para esse problema: prova formal. Um assistente de prova como o Lean 4 permite que um desenvolvedor não apenas escreva um programa, mas também escreva sua prova matemática. Se a prova for válida, é garantido que o código está correto; não "provavelmente correto", não "correto em casos testados", mas correto em termos matemáticos. O Lean 4 é utilizado por matemáticos para formular provas complexas e por engenheiros para certificar softwares críticos.

O problema é que escrever provas no Lean 4 é uma tarefa que requer especialização, lenta e trabalhosa. Essa é a lacuna que a Leanstral está tentando preencher.

O que Leanstral faz concretamente

Leanstral, uma agência de IA com 6 bilhões de parâmetros ativos, foi especificamente treinada para produzir provas formais. Não apenas gera código: também produz a prova que certifica esse código. O Lean 4 então valida essa prova. Se for inválida, é rejeitada. O validador não pode ser corrompido.

Esta é a primeira agência desse tipo de código aberto para o Lean 4. Os sistemas existentes ou criam camadas em torno de modelos gerais ou estão limitados a problemas matemáticos isolados. A Leanstral foi projetada para trabalhar em verdadeiros repositórios formais, com uma arquitetura esparsa e uma otimização específica para tarefas de prova.

Benchmarks e suas limitações

No FLTEval, em seus próprios conjuntos de avaliação, a Leanstral pontua 26,3 por 36 dólares (pass@2), enquanto o Claude Sonnet 4.6 pontua 23,7 por 549 dólares. No pass@16, a Leanstral pontua 31,9, superando o Sonnet por 8 pontos. O Claude Opus 4.6, com 39,6 pontos, está no topo em qualidade absoluta, mas a 1.650 dólares, ou seja, 92 vezes mais caro.

Esses números exigem uma leitura cuidadosa. FLTEval é um benchmark interno que não é replicável por terceiros. A comparação de custos entre um modelo privado com 6 bilhões de parâmetros ativos e grandes modelos gerais não é imparcial: é uma comparação entre uma ferramenta otimizada para uma tarefa específica e uma faca suíça. A capacidade da Leanstral de ir além do projeto matemático FLT que foi avaliado ainda não foi comprovada. Finalmente, todos os testes foram realizados no ambiente Mistral Vibe.

Por que é importante além das matemáticas

A verdadeira questão é a confiança em agências autônomas. Hoje, uma agência de IA escreve código e opera sobre dados, sem validação de cada linha. Uma agência que pode provar formalmente exatamente o que o código deve fazer muda a situação: o humano especifica o resultado esperado, a máquina prova que isso foi produzido. A auditoria muda de validação linha por linha para a definição das especificações.

A Leanstral está imediatamente disponível através do Mistral Vibe (comando /leanstall), acessível através de uma API gratuita (labs-leanstral-2603) e baixando pesos diretamente sob a licença Apache 2.0.

Um reposicionamento estratégico definitivo

Quando esses três anúncios são lidos juntos, não são apenas lançamentos de produtos isolados. Eles definem um roteiro.

- Small 4 abrange o mercado empresarial com um modelo versátil, de alto desempenho e econômico.

- A coalizão Nemotron confere à Mistral um ativo na definição dos padrões globais de IA de código aberto.

- Leanstral demonstra uma profundidade de P&D além dos modelos de conversa.

Mistral, este ano visa um faturamento de um bilhão de euros, está construindo um centro de dados na Suécia, assinou um contrato com o Ministério da Defesa em janeiro e adquiriu a Koyeb em fevereiro. Tudo isso está sendo realizado mantendo uma política de código aberto consistente com a licença Apache 2.0. A pergunta que fica é sobre sustentabilidade: quanto tempo uma empresa em hiper crescimento pode continuar a publicar seus modelos gratuitamente, enquanto financia a enorme infraestrutura necessária para treiná-los?

Comentários

(3 Comentários)