In un solo giorno, la startup con sede a Parigi ha fatto tre grandi annunci che convalidano l'obiettivo di diventare un elemento imprescindibile nell'infrastruttura globale dell'AI. Ecco gli effetti concreti di questa situazione.

Cose da ricordare:

- Mistral Small 4, per la prima volta, combina ragionamento, multimodalità e strumento di codifica in un unico modello, sotto licenza Apache 2.0.

- Mistral si unisce come membro fondatore della coalizione Nemotron di NVIDIA insieme a Perplexity, Cursor e Black Forest Labs.

- Leanstral è il primo agente open source in grado di generare prove ufficiali per Lean 4, e il rapporto costo/efficienza dichiarato è 15 volte superiore rispetto ai concorrenti generali.

- Questi tre annunci dimostrano che Mistral si sta riposizionando non più come un'alternativa nazionale, ma come un attore di riferimento globale.

Small 4: Un modello che cambia le distribuzioni

Fino ad oggi, i team tecnici che volevano utilizzare i modelli Mistral dovevano scegliere Magistral per il ragionamento, Pixtral per l'elaborazione delle immagini e Devstral per lo strumento di codifica. Mistral Small 4 pone fine a questa frammentazione.

Il modello si basa su un'architettura di Mix di Esperti (MoE) con un totale di 119 miliardi di parametri, ma solo 6 miliardi sono attivi per ogni richiesta. Questo modo di operare consente di limitare i costi di calcolo in ogni inferenza, mantenendo al contempo la capacità complessiva. Mistral offre, rispetto a Small 3, un ritardo inferiore del 40% e tre volte più richieste al secondo in una configurazione ottimizzata.

La finestra di contesto raggiunge 256.000 token, consentendo di elaborare documenti lunghi senza tagli. Il modello accetta sia testo che immagini come input.

Il miglioramento più notevole per utilizzi professionali è il parametro reasoning_effort. Questo consente all'utente di scegliere tra una risposta rapida e leggera equivalente al comportamento di Small 3 e un'analisi più approfondita e passo passo. Pertanto, una sola distribuzione soddisfa esigenze che prima richiedevano tre.

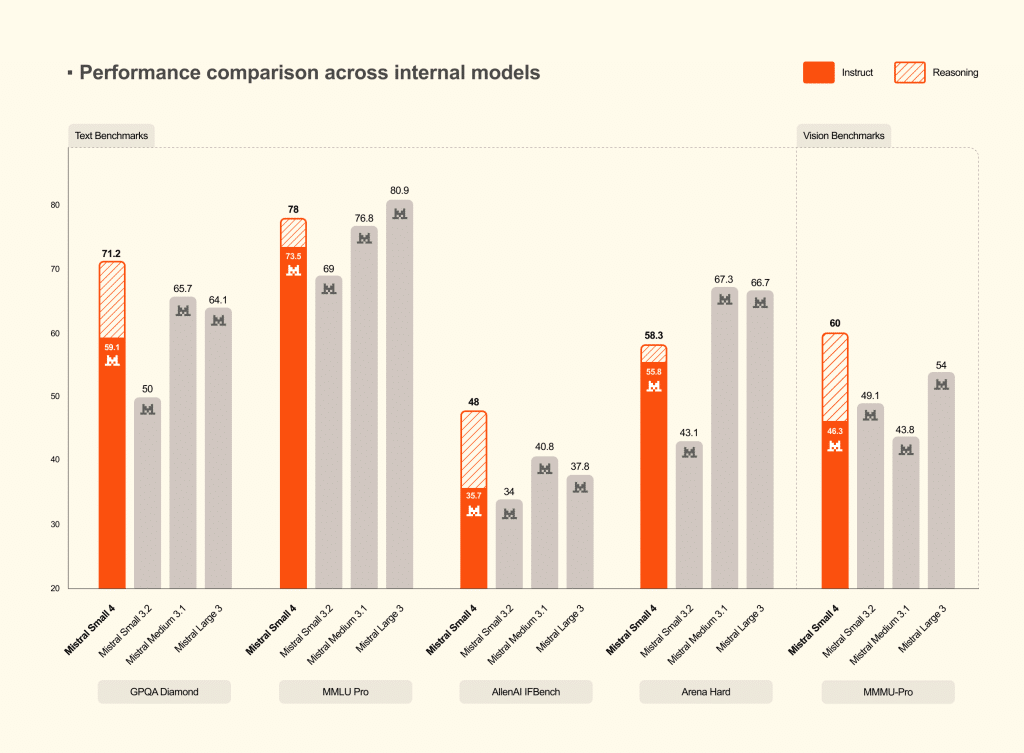

Nei benchmark, Mistral riporta che Small 4 ha eguagliato o superato GPT-OSS 120B quando il ragionamento è attivato, producendo uscite significativamente più brevi. Uscite più brevi significano meno ritardi, costi di inferenza più bassi e una migliore esperienza utente in produzione.

Il modello è disponibile come API Mistral, contenitore NVIDIA NIM ottimizzato per distribuzioni Hugging Face e on-premise. Pubblicato sotto licenza Apache 2.0, è compatibile con i principali framework di inferenza: vLLM, llama.cpp, SGLang e Transformers.

Coalizione Nemotron: Mistral al tavolo dei grandi

Questo è probabilmente l'annuncio più strategico della giornata. Mistral si unisce come membro fondatore della coalizione Nemotron di NVIDIA, insieme a Cursor, Perplexity, Black Forest Labs e il laboratorio di Mira Murati.

Lo scopo di questa coalizione è co-sviluppare un modello di base open source, Nemotron 4, che sarà addestrato nel cloud DGX di NVIDIA. Il modello sarà poi pubblicato come open source per la personalizzazione dell'intera industria. Ogni membro porta competenze complementari come architettura del modello per Mistral, ricerca per Perplexity, orchestrazione per LangChain e multimodalità per Black Forest Labs.

Per Mistral, questo significa accesso all'infrastruttura di calcolo di NVIDIA, consentendo di addestrare modelli su scala che non potrebbe finanziare autonomamente. In cambio, la startup offre tecniche di addestramento, capacità multimodali e strumenti di fine-tuning orientati all'operatività.

La logica industriale è chiara. Contro gli ecosistemi chiusi di OpenAI e Google, questa coalizione si configura come una forza coordinata del campo open source. Per NVIDIA, un modello di riferimento ottimizzato per i propri chip aumenta meccanicamente la domanda di hardware.

Questa alleanza non è priva di tensioni. Il cloud DGX in cui verrà addestrato Nemotron 4 è di proprietà di NVIDIA. Mistral ha compreso bene: l'azienda sta investendo nelle proprie capacità di calcolo in Francia e Svezia, in modo che questa partnership rimanga una scelta strategica e non diventi una dipendenza forzata. La questione della sovranità tecnologica è ancora attuale: Mistral sta rafforzando il legame con un attore soggetto a regolamenti esteri statunitensi.

Leanstral: la prova che l'IA è corretta

Il terzo annuncio è il più tecnico. Oggi si rivolge a un pubblico limitato, ma affronta una questione fondamentale relativa all'agenzia.

Il problema che Leanstral cerca di risolvere

Quando un'agenzia di IA genera codice oggi, il risultato è probabilistico. Il codice sembra corretto, supera i test, ma non c'è alcuna garanzia certa. La verifica si basa sugli esseri umani; essi leggono di nuovo, testano e correggono. Man mano che le agenzie producono più rapidamente, questo collo di bottiglia umano diventa critico.

Esiste una soluzione a questo problema: prova formale. Un assistente alla prova come Lean 4 consente a uno sviluppatore non solo di scrivere un programma, ma anche di scrivere la sua prova matematica. Se la prova è valida, si garantisce che il codice sia corretto; non "probabilmente corretto", non "corretto nei casi testati", ma corretto in senso matematico. Lean 4 è utilizzato da matematici per formulare prove complesse e da ingegneri per certificare software critici.

Il problema è che scrivere prove in Lean 4 è un compito che richiede competenza, lento e laborioso. Questo è il vuoto che Leanstral cerca di colmare.

Cosa fa concretamente Leanstral

Leanstral, un'agenzia di IA con 6 miliardi di parametri attivi, è stata appositamente addestrata per generare prove formali. Non si limita a generare codice: produce anche la prova che certifica quel codice. Lean 4 verifica poi questa prova. Se è invalida, viene rifiutata. Il validatore non può corrompersi.

Questa è la prima agenzia open source di questo tipo per Lean 4. I sistemi esistenti creano strati attorno a modelli generali o sono limitati a problemi matematici isolati. Leanstral è progettato per lavorare in veri pool ufficiali, con un'architettura rara e un'ottimizzazione specifica per i compiti di prova.

Benchmark e limitazioni

In FLTEval, nei propri set di valutazione, Leanstral ottiene 26,3 punti a 36 dollari (pass@2), mentre Claude Sonnet 4.6 ottiene 23,7 punti a 549 dollari. A pass@16, Leanstral ottiene 31,9 punti, superando Sonnet di 8 punti. Claude Opus 4.6 è al top della qualità assoluta con 39,6 punti, ma a 1.650 dollari, cioè 92 volte più costoso.

Questi numeri richiedono una lettura attenta. FLTEval è un benchmark interno non ripetibile da terzi. Il confronto di costo tra un modello privato con 6 miliardi di parametri e grandi modelli generali non è imparziale: è un confronto tra uno strumento ottimizzato per un compito specifico e un coltellino svizzero. La capacità di Leanstral di superare il progetto matematico FLT in cui è stato valutato non è ancora stata dimostrata. Infine, tutti i test sono stati condotti nell'ambiente Mistral Vibe.

Perché è importante oltre la matematica

La vera questione è la fiducia nelle agenzie autonome. Oggi, un'agenzia di IA scrive codice e opera sui dati, senza la verifica di ogni riga. Un'agenzia in grado di provare formalmente cosa deve fare il codice cambia la situazione: l'essere umano specifica il risultato atteso, la macchina prova che è stato prodotto. L'audit si sposta dalla verifica riga per riga alla definizione delle specifiche.

Leanstral è immediatamente disponibile tramite Mistral Vibe (comando /leanstall), accessibile gratuitamente tramite un'API (labs-leanstral-2603) e scaricando direttamente i pesi sotto licenza Apache 2.0.

Una riposizionamento strategico definitivo

Quando si leggono insieme questi tre annunci, non sono solo uscite di prodotto isolate. Definiscono una roadmap.

- Small 4 copre il mercato aziendale con un modello versatile, performante e conveniente.

- La coalizione Nemotron conferisce a Mistral una presenza nella definizione degli standard globali per l'IA open source.

- Leanstral dimostra una profondità di R&S oltre i modelli di conversazione.

Mistral prevede un fatturato di un miliardo di euro quest'anno, sta costruendo un centro dati in Svezia, ha firmato un contratto con il Ministero della Difesa a gennaio e ha acquistato Koyeb a febbraio. Tutto questo viene realizzato mantenendo una politica open source coerente con la licenza Apache 2.0. L'unica domanda rimasta è la sostenibilità: per quanto tempo un'azienda in iper crescita può continuare a pubblicare i propri modelli gratuitamente, mentre finanzia l'enorme infrastruttura necessaria per addestrarli?

Commenti

(3 Commenti)