Innerhalb eines einzigen Tages hat das in Paris ansässige Startup drei große Ankündigungen gemacht, die das Ziel bestätigen, ein unverzichtbarer Baustein in der globalen KI-Infrastruktur zu werden. Hier sind die konkreten Auswirkungen dieser Situation.

Wichtige Punkte:

- Mistral Small 4 kombiniert erstmals Denken, multimodale und Code-Tools in einem einzigen Modell, unter der Apache 2.0 Lizenz.

- Mistral tritt als Gründungsmitglied der NVIDIA Nemotron-Koalition zusammen mit Perplexity, Cursor und Black Forest Labs bei.

- Leanstral ist die erste Open-Source-Agentur, die offizielle Beweise für Lean 4 erzeugen kann, und das behauptete Kosten-Nutzen-Verhältnis liegt 15-mal über dem der allgemeinen Wettbewerber.

- Diese drei Ankündigungen zeigen, dass sich Mistral nicht mehr als nationale Alternative, sondern als globaler Referenzspieler neu positioniert hat.

Small 4: Ein Modell, das drei Distributionsarten verändert

Bisher mussten technische Teams, die Mistral-Modelle nutzen wollten, Magistral für das Denken, Pixtral für die Bildverarbeitung und Devstral für die Code-Tools auswählen. Mistral Small 4 beendet diese Fragmentierung.

Das Modell basiert auf einer Expertenmix-Architektur (MoE) mit insgesamt 119 Milliarden Parametern, wobei jedoch nur 6 Milliarden bei jeder Abfrage aktiv sind. Diese Arbeitsweise ermöglicht es, die Berechnungskosten bei jeder Schlussfolgerung zu begrenzen und gleichzeitig die Gesamtkapazität zu erhalten. Mistral bietet im Vergleich zu Small 3 eine um 40 % geringere Latenz und liefert in einer optimierten Konfiguration dreimal so viele Abfragen pro Sekunde.

Das Kontextfenster erreicht 256.000 Token und ermöglicht die Verarbeitung langer Dokumente, ohne sie zu kürzen. Das Modell akzeptiert sowohl Text als auch Bilder als Eingabe.

Die bemerkenswerteste Ergänzung für professionelle Anwendungen ist der reasoning_effort Parameter. Er ermöglicht dem Benutzer die Wahl zwischen einer schnellen und leichten Antwort, die dem Verhalten von Small 3 entspricht, und einer tiefergehenden, schrittweisen Analyse. Somit erfüllt eine einzige Distribution die Anforderungen, die zuvor drei erforderten.

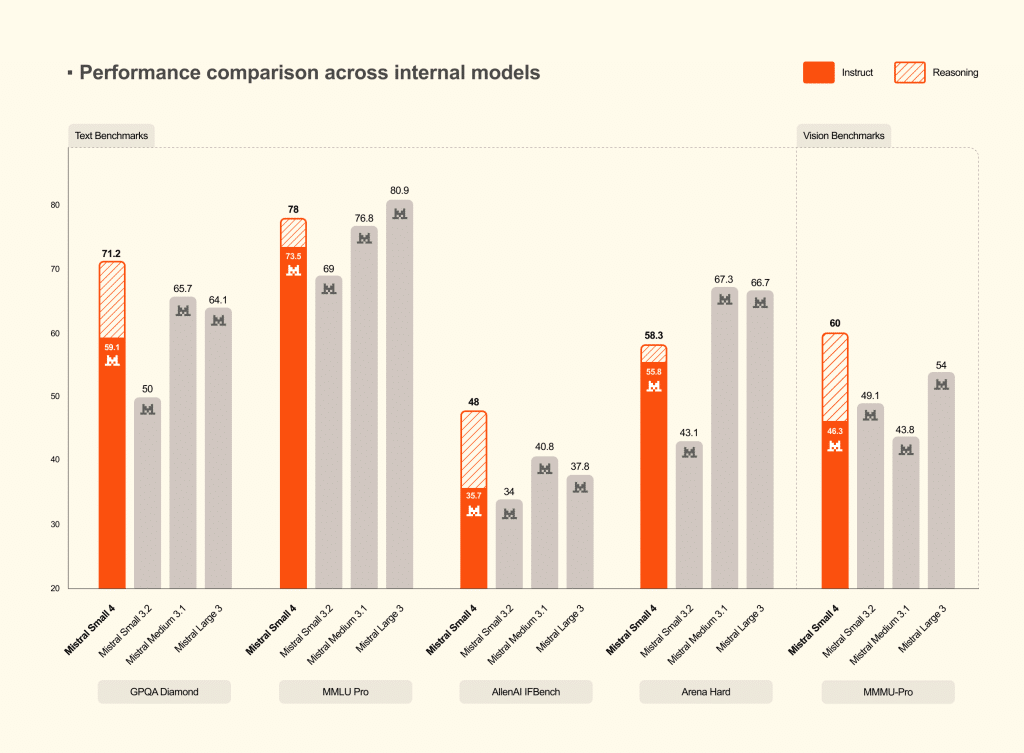

In Benchmarks berichtet Mistral, dass Small 4 bei aktiviertem Denken die GPT-OSS 120B erreicht oder übertrifft und dabei deutlich kürzere Ausgaben produziert. Kürzere Ausgaben bedeuten weniger Latenz, niedrigere Schlussfolgerungskosten und eine bessere Benutzererfahrung in der Produktion.

Das Modell ist als Mistral API, optimierter NVIDIA NIM-Container für Hugging Face und On-Premise-Distributionen verfügbar. Es wird unter der Apache 2.0 Lizenz veröffentlicht und ist mit gängigen Schlussfolgerungsrahmen kompatibel: vLLM, llama.cpp, SGLang und Transformers.

Nemotron-Koalition: Mistral am Tisch der Großen

Dies ist wahrscheinlich die strategischste Ankündigung des Tages. Mistral tritt als Gründungsmitglied der NVIDIA Nemotron-Koalition zusammen mit Cursor, Perplexity, Black Forest Labs und dem Mira Murati-Labor bei.

Das Ziel dieser Koalition ist es, ein Open-Source-Grundmodell gemeinsam zu entwickeln, Nemotron 4 wird in NVIDIA's DGX-Cloud trainiert. Das Modell wird dann als Open Source veröffentlicht, um der gesamten Industrie Anpassungen zu ermöglichen. Jedes Mitglied bringt komplementäre Expertise mit, wie mehrsprachige und Modellarchitektur für Mistral, Forschung für Perplexity, Orchestrierung für LangChain und Multimodalität für Black Forest Labs.

Für Mistral bedeutet dies den Zugang zur Recheninfrastruktur von NVIDIA, wodurch sie Modelle in einem Umfang trainieren können, den sie sich alleine nicht finanzieren könnten. Im Gegenzug bietet das Startup Schulungstechniken, multimodale Fähigkeiten und Feinabstimmungstools für Unternehmen an.

Die industrielle Logik ist klar. Gegen die geschlossenen Ökosysteme von OpenAI und Google, koordiniert diese Koalition die offene Quelle als eine gebündelte Kraft. Für NVIDIA bedeutet ein optimiertes Referenzmodell für ihre Chips eine mechanische Steigerung der Hardware-Nachfrage.

Dieses Bündnis ist nicht ohne Spannungen. Die DGX-Cloud, in der Nemotron 4 trainiert wird, gehört NVIDIA. Mistral hat dies gut verstanden: das Unternehmen investiert in seine eigenen Rechenfähigkeiten in Frankreich und Schweden, sodass diese Partnerschaft eine strategische Entscheidung bleibt und nicht zu einer zwingenden Abhängigkeit wird. Die Frage der technologischen Souveränität ist nach wie vor aktuell: Mistral stärkt die Verbindung zu einem Akteur, der den US-amerikanischen Auslandsregulierungen unterliegt.

Leanstral: Der Beweis, dass KI richtig ist

Die dritte Ankündigung ist die technischste. Sie richtet sich heute an ein begrenztes Publikum, behandelt jedoch ein grundlegendes Problem der Agentur.

Das Problem, das Leanstral zu lösen versucht

Wenn eine KI-Agentur heute Code generiert, ist das Ergebnis probabilistisch. Der Code sieht korrekt aus, besteht die Tests, aber es gibt keine absolute Garantie. Die Validierung beruht auf Menschen; sie lesen, testen und korrigieren ihn erneut. Je schneller die Agenturen produzieren, desto kritischer wird diese menschliche Engstelle.

Es gibt eine Lösung für dieses Problem: offizielle Beweise. Ein Beweisassistent wie Lean 4 ermöglicht es einem Entwickler, nicht nur ein Programm zu schreiben, sondern auch dessen mathematischen Beweis zu erstellen. Wenn der Beweis gültig ist, wird garantiert, dass der Code korrekt ist; nicht "wahrscheinlich korrekt", nicht "in getesteten Fällen korrekt", sondern mathematisch korrekt. Lean 4 wird von Mathematikern zur Formulierung komplexer Beweise und von Ingenieuren zur Zertifizierung kritischer Software verwendet.

Das Problem ist, dass das Schreiben von Beweisen in Lean 4 eine spezialisierte, langsame und mühsame Aufgabe ist. Das ist die Lücke, die Leanstral zu füllen versucht.

Was Leanstral konkret tut

Leanstral, eine KI-Agentur mit 6 Milliarden aktiven Parametern, wurde speziell darauf trainiert, offizielle Beweise zu erzeugen. Sie produziert nicht nur Code: sie erzeugt auch den Beweis, der diesen Code zertifiziert. Lean 4 validiert dann diesen Beweis. Wenn er ungültig ist, wird er abgelehnt. Der Validator kann nicht betrügen.

Dies ist die erste Open-Source-Agentur dieser Art für Lean 4. Bestehende Systeme bilden entweder Schichten um allgemeine Modelle oder sind auf isolierte mathematische Probleme beschränkt. Leanstral wurde entwickelt, um in echten offiziellen Pools zu arbeiten, mit einer spärlichen Architektur und spezifischer Optimierung für Beweisaufgaben.

Benchmarks und Einschränkungen

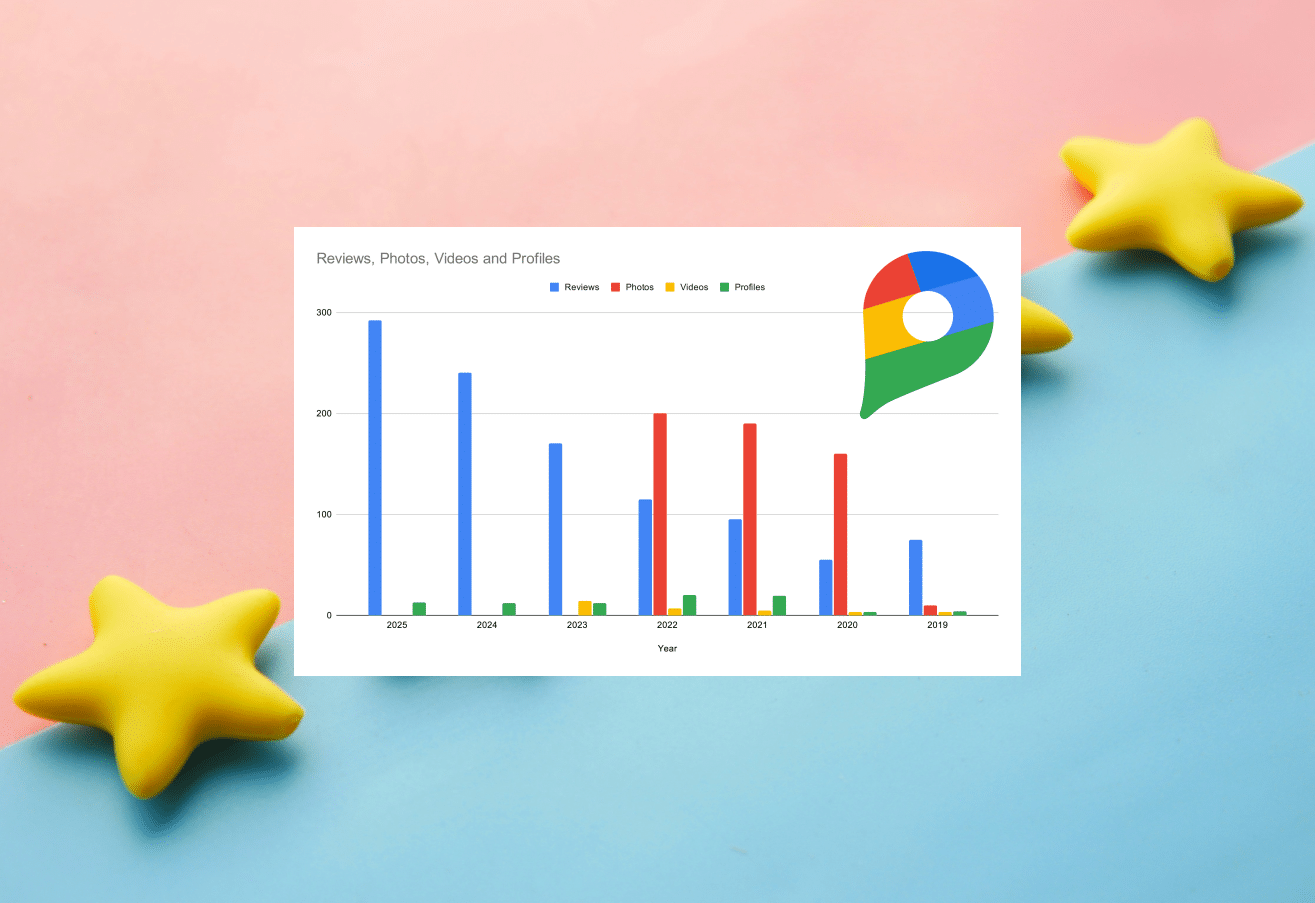

In FLTEval erzielt Leanstral in seinen eigenen Bewertungssätzen 26,3 Punkte für 36 Dollar (pass@2), während Claude Sonnet 4.6 für 549 Dollar 23,7 Punkte erreicht. Bei pass@16 erzielt Leanstral 31,9 Punkte und übertrifft Sonnet um 8 Punkte. Claude Opus 4.6 ist mit 39,6 Punkten in absoluter Qualität am besten, kostet jedoch 1.650 Dollar, also 92-mal so viel.

Diese Zahlen erfordern eine sorgfältige Betrachtung. FLTEval ist ein interner Benchmark, der nicht von Dritten reproduziert wird. Der Kostenvergleich zwischen einem speziellen Modell mit 6 Milliarden aktiven Parametern und großen allgemeinen Modellen ist nicht neutral: es ist ein Vergleich zwischen einem für eine bestimmte Aufgabe optimierten Werkzeug und einem Schweizer Taschenmesser. Die Fähigkeit von Leanstral, über das mathematische FLT-Projekt hinauszugehen, ist noch nicht bewiesen. Schließlich wurden alle Tests in der Mistral Vibe-Umgebung durchgeführt.

Warum es über Mathematik hinaus wichtig ist

Das eigentliche Thema ist das Vertrauen in autonome Agenturen. Heute schreibt eine KI-Agentur Code und verarbeitet Daten, ohne dass jede Zeile validiert wird. Eine Agentur, die offiziell beweisen kann, was der Code genau tun soll, verändert die Situation: der Mensch gibt das erwartete Ergebnis an, die Maschine beweist, dass es produziert wurde. Die Überprüfung wechselt von der zeilenweisen Validierung zur Definition der Spezifikationen.

Leanstral ist sofort über Mistral Vibe verfügbar (Befehl /leanstall), über eine kostenlose API (labs-leanstral-2603) zugänglich und kann die Gewichte direkt unter der Apache 2.0-Lizenz herunterladen.

Eine definitive strategische Neupositionierung

Wenn man diese drei Ankündigungen zusammen liest, sind sie nicht nur isolierte Produktveröffentlichungen. Sie definieren eine Roadmap.

- Small 4 deckt den Geschäftmarkt mit einem vielseitigen, leistungsstarken und kosteneffizienten Modell ab.

- Die Nemotron-Koalition verleiht Mistral eine Rolle bei der Festlegung globaler Standards für Open-Source-KI.

- Leanstral zeigt eine Forschungstiefe, die über Chat-Modelle hinausgeht.

Mistral strebt in diesem Jahr einen Umsatz von einer Milliarde Euro an, baut ein Rechenzentrum in Schweden, hat im Januar einen Vertrag mit dem Verteidigungsministerium unterzeichnet und im Februar Koyeb übernommen. All dies geschieht im Einklang mit einer offenen Quellenpolitik, die mit der Apache 2.0-Lizenz übereinstimmt. Die offene Frage ist die Nachhaltigkeit: Wie lange kann ein Unternehmen mit hyperwachstum seine Modelle kostenlos veröffentlichen und gleichzeitig die enorme Infrastruktur finanzieren, die für deren Training erforderlich ist?

Kommentare

(3 Kommentare)