En un solo día, la startup con sede en París hizo tres grandes anuncios que validan su objetivo de convertirse en un componente indispensable de la infraestructura global de IA. Aquí están los efectos concretos de esta situación.

Aspectos a recordar:

- Mistral Small 4 combina por primera vez razonamiento, multimodalidad y herramientas de codificación en un solo modelo, bajo la licencia Apache 2.0.

- Mistral se une como miembro fundador de la coalición Nemotron de NVIDIA junto a Perplexity, Cursor y Black Forest Labs.

- Leanstral es el primer agente de código abierto que puede generar pruebas formales para Lean 4, y su supuesta relación costo/efectividad es 15 veces superior a la de los competidores generales.

- Estos tres anuncios muestran que Mistral ya no se está reposicionando como una alternativa nacional, sino como un jugador de referencia global.

Small 4: Un modelo que cambia las distribuciones

Hasta ahora, los equipos técnicos que querían utilizar los modelos de Mistral tenían que elegir entre Magistral para razonamiento, Pixtral para procesamiento de imágenes y Devstral para herramientas de codificación. Mistral Small 4 pone fin a esta fragmentación.

El modelo se basa en una arquitectura de Mezcla de Expertos (MoE) con un total de 119 mil millones de parámetros, pero solo 6 mil millones activos en cada consulta. Esta forma de trabajar permite limitar el costo computacional en cada inferencia, al tiempo que se mantiene la capacidad general. Mistral ofrece un 40% menos de latencia en comparación con Small 3 y presenta tres veces más consultas por segundo en una configuración optimizada.

La ventana de contexto alcanza 256,000 tokens, permitiendo procesar documentos largos sin cortarlos. El modelo acepta tanto texto como imágenes como entrada.

La adición más notable para usos profesionales es el parámetro reasoning_effort. Permite al usuario elegir entre una respuesta rápida y ligera equivalente al comportamiento de Small 3 y un análisis más profundo y paso a paso. Por lo tanto, una sola distribución satisface necesidades que antes requerían tres.

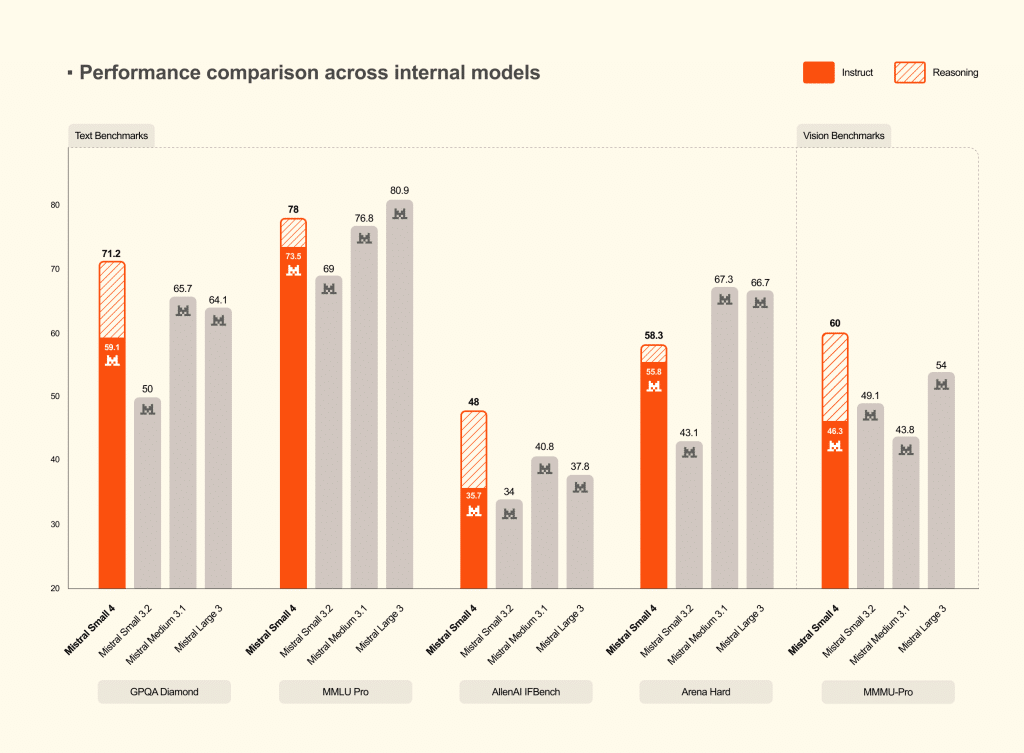

En los benchmarks, Mistral informa que Small 4 iguala o supera a GPT-OSS 120B cuando se activa el razonamiento y produce salidas significativamente más cortas. Las salidas más cortas significan menos latencia, menores costos de inferencia y una mejor experiencia de usuario en producción.

El modelo está disponible como API de Mistral, contenedor NVIDIA NIM optimizado para implementaciones en Hugging Face y en local. Se publica bajo la licencia Apache 2.0 y es compatible con los marcos de inferencia más comunes: vLLM, llama.cpp, SGLang y Transformers.

Coalición Nemotron: Mistral en la mesa de los grandes

Este es probablemente el anuncio más estratégico del día. Mistral se une como miembro fundador de la coalición Nemotron de NVIDIA, junto a Cursor, Perplexity, Black Forest Labs y el laboratorio de Mira Murati.

El objetivo de esta coalición es co-desarrollar un modelo base de código abierto, Nemotron 4, que se entrenará en la nube DGX de NVIDIA. El modelo se publicará posteriormente como código abierto para la personalización de toda la industria. Cada miembro aporta una especialización complementaria, como arquitectura de modelo multilingüe para Mistral, investigación para Perplexity, orquestación para LangChain y multimodalidad para Black Forest Labs.

Para Mistral, esto significa acceso a la infraestructura de computación de NVIDIA, lo que le permitirá entrenar modelos a una escala que no podría financiar por sí solo. A cambio, la startup ofrece técnicas de entrenamiento, capacidades multimodales y herramientas de ajuste fino orientadas al negocio.

La lógica industrial es clara. Contra los ecosistemas cerrados de OpenAI y Google, esta coalición se configura como una fuerza coordinadora del campamento de código abierto. Para NVIDIA, un modelo de referencia optimizado para sus chips aumenta mecánicamente la demanda de hardware.

Esta alianza no está exenta de tensiones. La nube DGX en la que se entrenará a Nemotron 4 pertenece a NVIDIA. Mistral lo ha entendido bien: la empresa está invirtiendo en sus propias capacidades de computación en Francia y Suecia, de modo que esta asociación permanece como una elección estratégica y no se convierte en una dependencia obligatoria. La cuestión de la soberanía tecnológica sigue en la agenda: Mistral está fortaleciendo su vínculo con un actor sujeto a regulaciones extranjeras de EE. UU.

Leanstral: La prueba de que la IA es correcta

El tercer anuncio es el más técnico. Hoy se dirige a un público limitado, pero aborda un tema fundamental relacionado con la agencia.

El problema que Leanstral intenta resolver

Hoy, cuando una agencia de IA genera código, el resultado es probabilístico. El código parece correcto, pasa las pruebas, pero no hay garantía definitiva. La verificación depende de las personas; ellos vuelven a leer, prueban y corrigen. A medida que las agencias producen más rápido, este embotellamiento humano se vuelve crítico.

Hay una solución a este problema: prueba formal. Un asistente de prueba como Lean 4 permite a un desarrollador no solo escribir un programa, sino también escribir su prueba matemática. Si la prueba es válida, se garantiza que el código es correcto; no "probablemente correcto", no "correcto en casos probados", sino correcto en el sentido matemático. Lean 4 es utilizado por matemáticos para formular pruebas complejas y por ingenieros para certificar software crítico.

El problema es que escribir pruebas en Lean 4 es una tarea especializada, lenta y laboriosa. Este es el vacío que Leanstral intenta llenar.

Lo que Leanstral hace de manera concreta

Leanstral, una agencia de IA con 6 mil millones de parámetros activos, ha sido entrenada específicamente para generar pruebas formales. No solo genera código: también produce la prueba que certifica ese código. Lean 4 luego valida esta prueba. Si es inválida, se rechaza. El validador no puede hacer trampa.

Esta es la primera agencia de este tipo de código abierto para Lean 4. Los sistemas existentes o bien crean capas alrededor de modelos generales o están limitados a problemas matemáticos aislados. Leanstral está diseñado para trabajar en verdaderos entornos formales, con una arquitectura escasa y una optimización específica para tareas de prueba.

Benchmarks y limitaciones

En FLTEval, en sus propios conjuntos de evaluación, Leanstral obtiene 26.3 puntos por 36 dólares (pass@2), mientras que Claude Sonnet 4.6 obtiene 23.7 puntos por 549 dólares. En pass@16, Leanstral obtiene 31.9 puntos, superando a Sonnet por 8 puntos. Claude Opus 4.6, con 39.6 puntos, está en la mejor posición en calidad absoluta, pero a 1,650 dólares, es decir, 92 veces más caro.

Estas cifras requieren una lectura cuidadosa. FLTEval es un benchmark interno que no puede ser replicado por terceros. La comparación de costos entre un modelo privado con 6 mil millones de parámetros y grandes modelos generales no es imparcial: es una comparación entre una herramienta optimizada para una tarea específica y una navaja suiza. La capacidad de Leanstral para ir más allá del proyecto matemático FLT en el que fue evaluado aún no ha sido probada. Finalmente, todas las pruebas se han realizado en el entorno Mistral Vibe.

Por qué es importante más allá de las matemáticas

El verdadero asunto es la confianza en las agencias autónomas. Hoy, una agencia de IA escribe código y opera sobre datos, sin la verificación de cada línea. Una agencia que puede probar formalmente exactamente lo que se supone que debe hacer el código cambia la situación: el humano especifica el resultado esperado, la máquina prueba que lo ha producido. La auditoría pasa de la verificación línea por línea a la definición de especificaciones.

Leanstral está disponible inmediatamente a través de Mistral Vibe (comando /leanstall), accesible a través de una API gratuita (labs-leanstral-2603) y descargando pesos directamente bajo la licencia Apache 2.0.

Un reposicionamiento estratégico definitivo

Cuando se leen juntos estos tres anuncios, no son solo lanzamientos de productos aislados. Definen una hoja de ruta.

- Small 4, abarca el mercado empresarial con un modelo versátil, de alto rendimiento y económico.

- La coalición Nemotron otorga a Mistral un papel en la definición de los estándares globales de IA de código abierto.

- Leanstral muestra una profundidad de I+D más allá de los modelos de conversación.

Mistral, este año tiene como objetivo un mil millones de euros en ingresos, está construyendo un centro de datos en Suecia, firmó un contrato con el Ministerio de Defensa en enero y adquirió Koyeb en febrero. Todo esto lo lleva a cabo manteniendo una política de código abierto coherente con la licencia Apache 2.0. La pregunta que queda es la sostenibilidad: ¿cuánto tiempo puede continuar una empresa en hipercrecimiento publicando sus modelos de forma gratuita mientras financia la enorme infraestructura necesaria para entrenarlos?

Comentarios

(3 Comentarios)