Websites haben gelernt, mit Browsern zu kommunizieren, und haben dann begonnen, mit Suchmaschinen zu interagieren. Cloudflare ist der Meinung, dass Websites nun lernen müssen, mit IA-Agenturen zu kommunizieren, und bietet ein Werkzeug an, das dabei helfen soll. Dies ist ein ehrgeiziges Unterfangen, wirft jedoch mehr Fragen auf als Lösungen.

Höhepunkte:

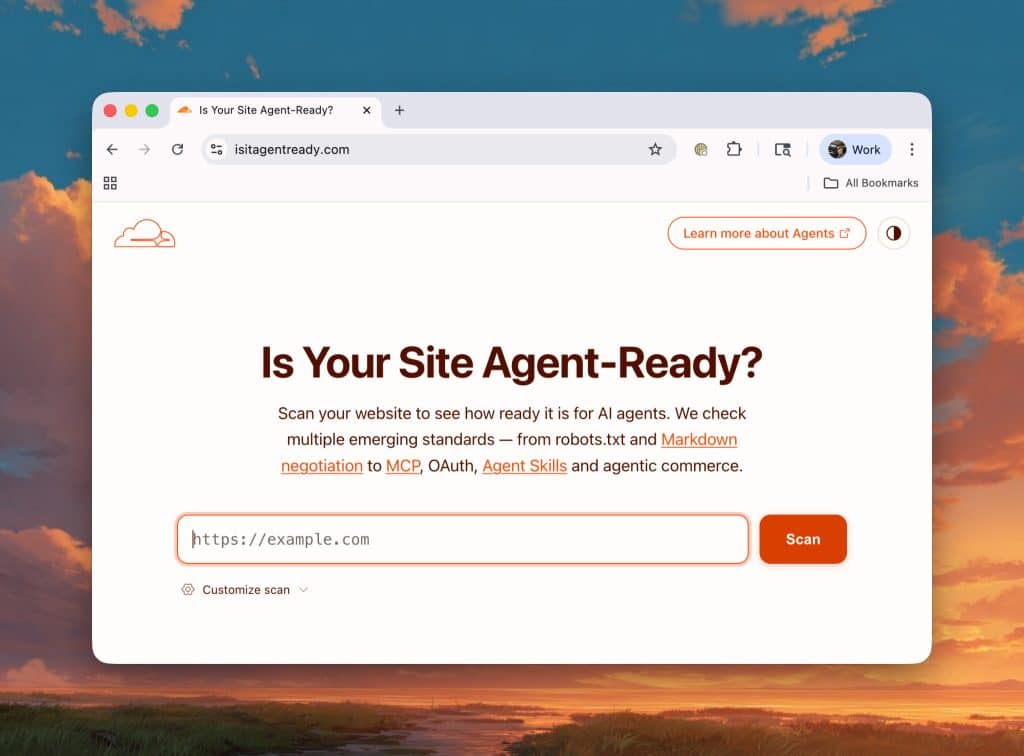

- Cloudflare hat ein kostenloses Werkzeug namens isitagentready.com gestartet, das die Kompatibilität von Websites mit IA-Agenturen in vier Dimensionen bewertet: Entdeckbarkeit, Inhalt, Zugriffskontrolle und Fähigkeiten.

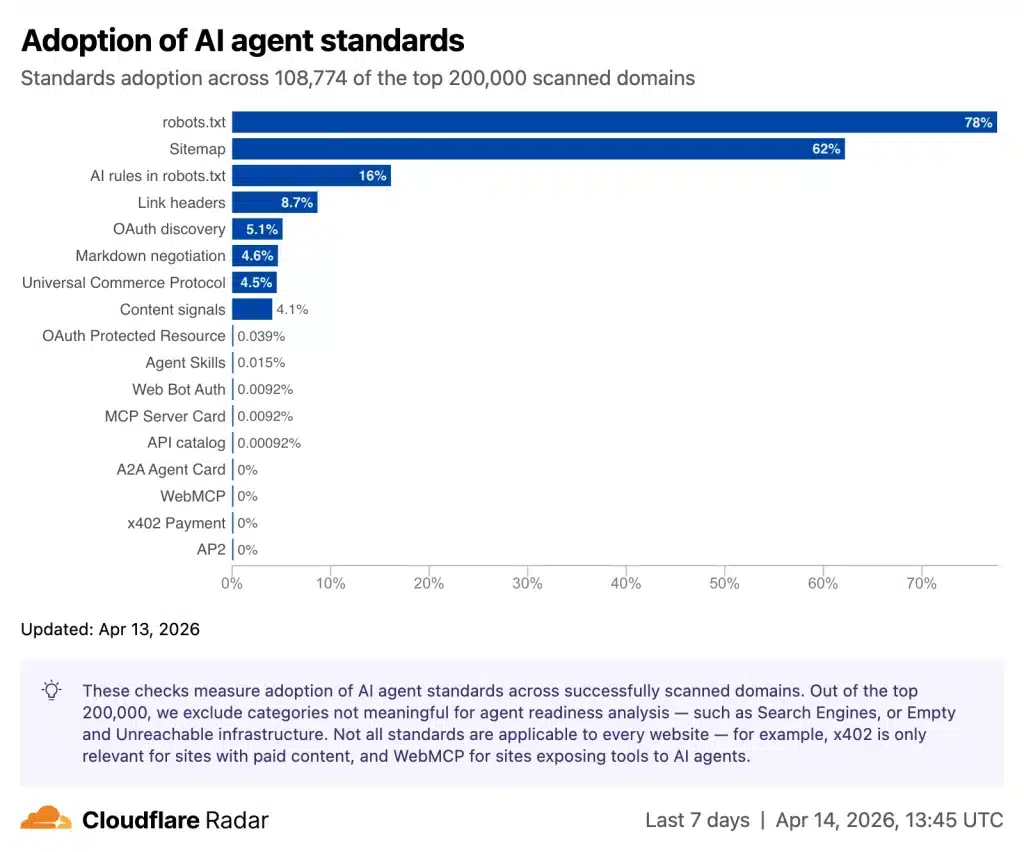

- Das Web ist noch nicht bereit: Von 200.000 analysierten Websites geben nur 4 % ihre Präferenzen für die Nutzung von IA an, und weniger als 15 Websites haben die neuesten Standards wie MCP Serverkarten oder API-Kataloge übernommen.

- Die Initiative basiert auf einem sich im Aufbau befindenden Standard-Ökosystem, was frühe Anwender dem Risiko von Fragmentierung oder schneller Veralterung aussetzt.

- Cloudflare befindet sich in der Position, sowohl die Bewertung vorzunehmen als auch Lösungen zur Verbesserung anzubieten, was Fragen aufwirft.

Bewertungstool für ein echtes Problem

Cloudflares Ausgangspunkt ist solide. Eine IA-Agentur, die auf eine Website zugreifen und Dokumentation lesen, Produkte kaufen oder mit einer API interagieren möchte, trifft auf eine Infrastruktur, die für Menschen entworfen wurde: komplexes HTML, Formulare, Sitzungen, Captchas. Infolgedessen entstehen langsame, tokenintensive und oft fehlerhafte Agenturen.

Cloudflare hat das Ausmaß des Problems gemessen, indem es die 200.000 meistbesuchten Domains durchsucht hat und sich auf Websites konzentriert hat, mit denen Agenturen sinnvoll interagieren können, indem es Weiterleitungen, Werbeserver und Tunnelservices filtert.

Das Ergebnis ist verblüffend: 78 % der Websites haben eine robots.txt-Datei, aber fast alle sind für traditionelle Suchmaschinen-Crawler geschrieben, nicht für Agenturen. Nur 3,9 % bieten Inhalte im Markdown-Format auf Anfrage an. Und neue Standards wie MCP Serverkarten sind in weniger als 15 Websites im gesamten Datensatz verfügbar.

Die von Cloudflare eingeführte Lösung isitagentready.com bietet eine Bewertung, die um vier Achsen strukturiert ist.

- Entdeckbarkeit überprüft die Existenz und Qualität von

robots.txt,sitemap.xmlund Link-Headern. - Inhalt bewertet, ob die Website eine saubere Markdown-Version bereitstellt, die den Anforderungen einer Agentur entspricht.

- Zugriffskontrolle prüft, ob die Website klare Präferenzen darüber äußert, was IA mit ihrem Inhalt tun kann.

- Schließlich testet Fähigkeiten die Verfügbarkeit fortschrittlicher Standards wie MCP Serverkarten, API-Katalog oder OAuth-Entdeckung, die es Agenturen ermöglichen, sich korrekt zu authentifizieren.

Noch in Entwicklung befindliche Standards und nahezu keine Akzeptanz

Hier sollte die Begeisterung von Cloudflare begrenzt werden. Viele der hervorgehobenen Standards sind entweder im Entwurf bei der IETF oder inoffizielle Vorschläge ohne Garantie der allgemeinen Akzeptanz. Der API-Katalog (RFC 9727), MCP Serverkarten oder Web Bot Auth sind einige neue Standards, die zum Zeitpunkt der Veröffentlichung noch keinen endgültigen RFC-Status erreicht haben.

Dies ist nicht nur ein Problem von Cloudflare: Es ist die Realität eines sich entwickelnden Webs. Diese Situation erfordert jedoch eine Ehrlichkeit, die in Cloudflares Blogbeitrag unterschätzt wird. Wenn man bedenkt, dass ein heute akzeptierter Standard innerhalb von achtzehn Monaten neu geordnet oder aufgegeben werden könnte, könnte dies eine Arbeitslast schaffen, die eine erneute Integration erfordert. Während große Akteure über die Ressourcen verfügen, um diesen Entwicklungen zu folgen, könnte dies für kleinere Teams oder unabhängige Entwickler nicht der Fall sein.

Das Beispiel llms.txt ist bemerkenswert. Dieser im September 2024 vorgeschlagene, standardisierte Datei zur Einführung einer Website bei einem LLM ist standardmäßig nicht in Cloudflares Bewertung enthalten, sondern nur optional. Der Grund? Der Standard befindet sich noch in der Diskussionsphase. Dies ist eine vorsichtige Entscheidung, zeigt aber auch, dass Cloudflare noch nicht weiß, welche Risiken es eingehen sollte.

Diskussion über Markdown-Inhalte: Ein gemessener echter Gewinn

Eine der greifbarsten und wahrscheinlich dringendsten Vorteile der Initiative ist die Fähigkeit eines Servers, im Markdown-Format zu antworten, wenn eine Agentur den Accept: text/markdown-Header sendet. Cloudflare behauptet, eine Reduzierung der Anzahl der benötigten Tokens um bis zu 80 % gemessen zu haben.

Der Kontext dieser Zahl ist wichtig. Das HTML einer technischen Dokumentationsseite ist oft sehr umfangreich: Navigation, Menüs, Skripte, verschachtelte Tags... all dies erzeugt für ein LLM reinen Lärm. Eine gut strukturierte Markdown-Datei ist der unverpackte Kern des Inhalts. Das direkte Ergebnis ist eine Senkung der Kosten für API-Aufrufe für Agenturen, eine Verringerung der Latenz und eine erhöhte Wahrscheinlichkeit, dass die Agentur den vollständigen Kontext ohne Unterbrechungen erhält.

Cloudflare erklärt, dass es seine eigene Dokumentationsseite (developers.cloudflare.com) getestet hat und eine Agentur (über Kimi-k2.5 OpenCode) zu mehreren technischen Seiten geleitet hat. Das Ergebnis: 31 % weniger Tokenverbrauch und 66 % schnellere, korrekte Antworten im Vergleich zu anderen nicht optimierten Seiten. Diese Zahlen sollten aufgrund der unüberprüften internen Testbedingungen mit Vorsicht betrachtet werden. Die Größenordnung stimmt jedoch mit dem Bekannten über die strukturelle Überladung von HTML überein.

Technische Implementierung in Cloudflare Docs: Praktisch und wiederholbar

Der lehrreichste Teil des Artikels ist, wie Cloudflare seine eigene Dokumentation umstrukturiert hat. Der Ansatz ist interessant, da er ein echtes Problem überwindet: Von sieben getesteten Tools, die im Februar 2026 getestet wurden, senden nur drei (Claude Code, OpenCode und Cursor) automatisch den Accept: text/markdown-Header. Für die anderen ist eine Alternative erforderlich.

Die gewählte Lösung kombiniert zwei Cloudflare-Regeln:

- Eine URL-Umschreibung wandelt die Anfrage

/r2/get-started/index.mdin die Anfrage/r2/get-started/um, - und fügt automatisch den

Accept: text/markdown-Header zu diesen umgeschriebenen Anfragen hinzu.

Ergebnis: Jede Agentur kann durch Hinzufügen von /index.md zu einer URL auf die Markdown-Version jeder Seite zugreifen, ohne einen speziellen Header verwalten zu müssen.

Eine weitere bemerkenswerte Entscheidung: Anstelle einer einzigen großen llms.txt-Datei (Cloudflare-Dokumentation enthält über 5.000 Seiten) hat jedes erste Verzeichnis seine eigene Datei, und die Stammdatei verweist auf diese Unterverzeichnisse. Dies verhindert die in dem Artikel beschriebene Grep-Schleife: Eine Agentur, die auf eine sehr lange Datei stößt, beginnt, den Überblick zu verlieren, sucht nach Schlüsselwörtern, erhöht die Aufrufe und verringert die Antwortqualität.

Granularität wurde ebenfalls sorgfältig berücksichtigt: Etwa 450 Seiten, die nur Verlinkungslisten (Verzeichnisseiten) enthalten, wurden von llms.txt ausgeschlossen, da sie für ein LLM keinen semantischen Wert für bereits individuell aufgelistete Unterseiten hinzufügen.

Ein Spieler, der Bewertungen vergibt und Bewertungsbereitschaft verkauft

Cloudflares Position erfordert eine sorgfältige Untersuchung. Das Unternehmen veröffentlicht eine Referenzbewertung für die Agenturvorbereitung, integriert diese Bewertung in den URL-Crawler, bietet vorgefertigte Vorlagen zur Behebung jedes Fehlers an... und verkauft Produkte (Workers, Rules, Access), um diese Korrekturen anzuwenden. isitagentready.com wird ebenfalls von Cloudflare angeboten und hostet einen MCP-Server.

Das ist nicht unbedingt problematisch: Google hat dasselbe mit Lighthouse und Core Web Vitals getan und ist zu einem Anbieter geworden, der sowohl Kriterien bewertet als auch Werkzeuge zur Verbesserung bereitstellt (über Google Cloud, Firebase usw.). Dies bedeutet jedoch, dass die Kriterien für die Bewertung sich sowohl nach den kommerziellen Interessen des Unternehmens als auch nach den tatsächlichen Bedürfnissen der Agenturen entwickeln können. Ein Standard, der von einem einzigen Unternehmen unterstützt wird, kann selbst bei bester Absicht die Richtlinien beeinflussen.

Außerdem ist es bemerkenswert, dass Cloudflare aktiv Standards für Agenturzahlungen (x402, Universal Commerce Protocol) fördert; einige dieser Standards beinhalten direkte Partner wie Coinbase. Diese Standards sind noch nicht in die Bewertung aufgenommen, aber ihre Präsenz im Tool deutet bereits auf eine Richtung hin.

Was Entwickler heute wirklich tun können

Trotz dieser Bedenken bieten viele Maßnahmen klare und sofortige Rückmeldungen, unabhängig von der Evolution der Standards:

- Das Anbieten von Markdown auf Anfrage ist technisch einfach, senkt die Kosten für API-Nutzer und verbessert die Antwortqualität für Agenturen. Dies hat Priorität.

- Das Anpassen von

robots.txtfür IA-Agenturen (z. B. durch Hinzufügen von Richtlinien für Crawler wieGPTBot,ClaudeBot,CCBot) ist eine gute Hygiene und kostengünstig und klärt die Zugriffsrechte. - Das Konfigurieren von

llms.txtauf Abschnittsbasis für Websites mit vielen Inhalten ist eine gute Dokumentationspraxis für sowohl Agenturen als auch Personen, die die Architektur einer Website schnell verstehen möchten.

Andererseits ist die Implementierung von MCP Serverkarten oder API-Katalogen für eine Website ohne öffentlich zugängliche API oder klaren Anwendungsfall für Agenturen gleichbedeutend mit dem Bau eines Warteraums ohne Besucher.

Akzeptanz als Marktindikator, nicht als Notwendigkeit

Der wahre Wert von Cloudflares Initiative liegt vielleicht im Radar-Datensatz: Ein Datensatz, der wöchentlich die Akzeptanz jedes Standards für die 200.000 meistbesuchten Websites verfolgt, segmentiert nach Domainkategorien. Solche Daten werden es ermöglichen zu messen, ob Standards tatsächlich Gewinn bringen oder ob die meisten Websites passiv bleiben, in der Erwartung, dass Agenturen sich anpassen, so wie sie es seit dreißig Jahren mit HTML tun.

Die Antwort auf diese Frage wird viel über die Machtverhältnisse zwischen Website-Publishern und Agentur-Entwicklern aussagen. Die beliebtesten Agenturen werden den Druck auf die Websites verringern, sich anzupassen, wenn sie über ausreichend robuste HTML-Parsing-Fähigkeiten verfügen. Im Gegenteil, wenn die Kosten und Zeiten für die Nutzung von nicht optimiertem HTML zu einem messbaren Wettbewerbsvorteil für angepasste Websites werden, wird die Akzeptanz natürlich steigen.

Kommentare

(6 Kommentare)